GENBOOST

Библиотека для оптимизации алгоритмов машинного обучения

Задача проекта:

Предложить альтернативный вариант оптимизации нейронных сетей

Что и как было сделано:

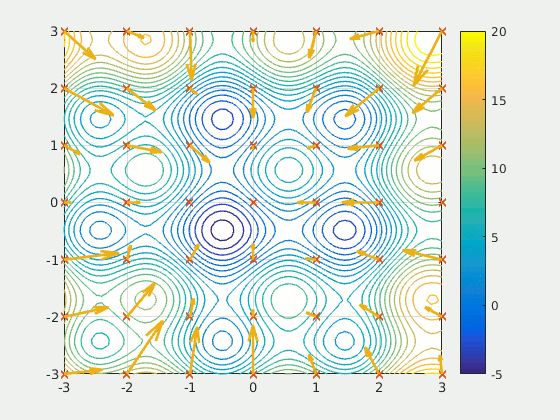

На основе открытого фреймворка PyGMO мы написали код для тестирования различных эвристических алгоритмов глобальной оптимизации для разных типов глубоких архитектур.

Рассматривались оптимизации весов в следующих архитектурах:

Полносвязная — задача классификации на датасете MNIST.

Рекуррентная — задача бинарной классификации на датасете IMDB.

Сверточная — задача классификации на датасете MNIST.

Было проведено поисковое исследование по выявлению лучших практик использования эволюционных алгоритмов в машинном обучении.

Цель проекта:

Сегодня все большее развитие получают методы машинного и, в частности, глубокого обучения. Одним из наиболее важных этапов создания модели глубокого обучения является ее обучение. В процессе обучения могут возникнуть затруднения различного характера: затухание градиентов, взрыв градиентов, сходимость к локальному максимуму, сильно отличному от глобального и пр. Зачастую, затруднения вызваны природой градиентного метода обучения.

Помимо градиентных методов существуют и другие. Мы рассмотрели эволюционные эвристические методы конечномерной оптимизации. Главной целью исследования было ответить на вопрос: «Могут ли эвристические методы глобальной оптимизации заменить или существенно улучшить градиентную парадигму?»

Особенности проекта:

— Исследовательский проект поискового типа.

— Работа с эволюционными алгоритмами.

— Попытка улучшить процессы обучения в глубоком обучении на глубоком уровне.

Сроки: 3 месяца

Команда проекта

R&D: Кондаратцев Вадим, Александр Корнеев, Евгений Хомутов

Год реализации проекта: 2019

Статья о проекте:

Как еще генетические алгоритмы могут помочь глубокому обучению?

Код можно найти на нашем GitHub